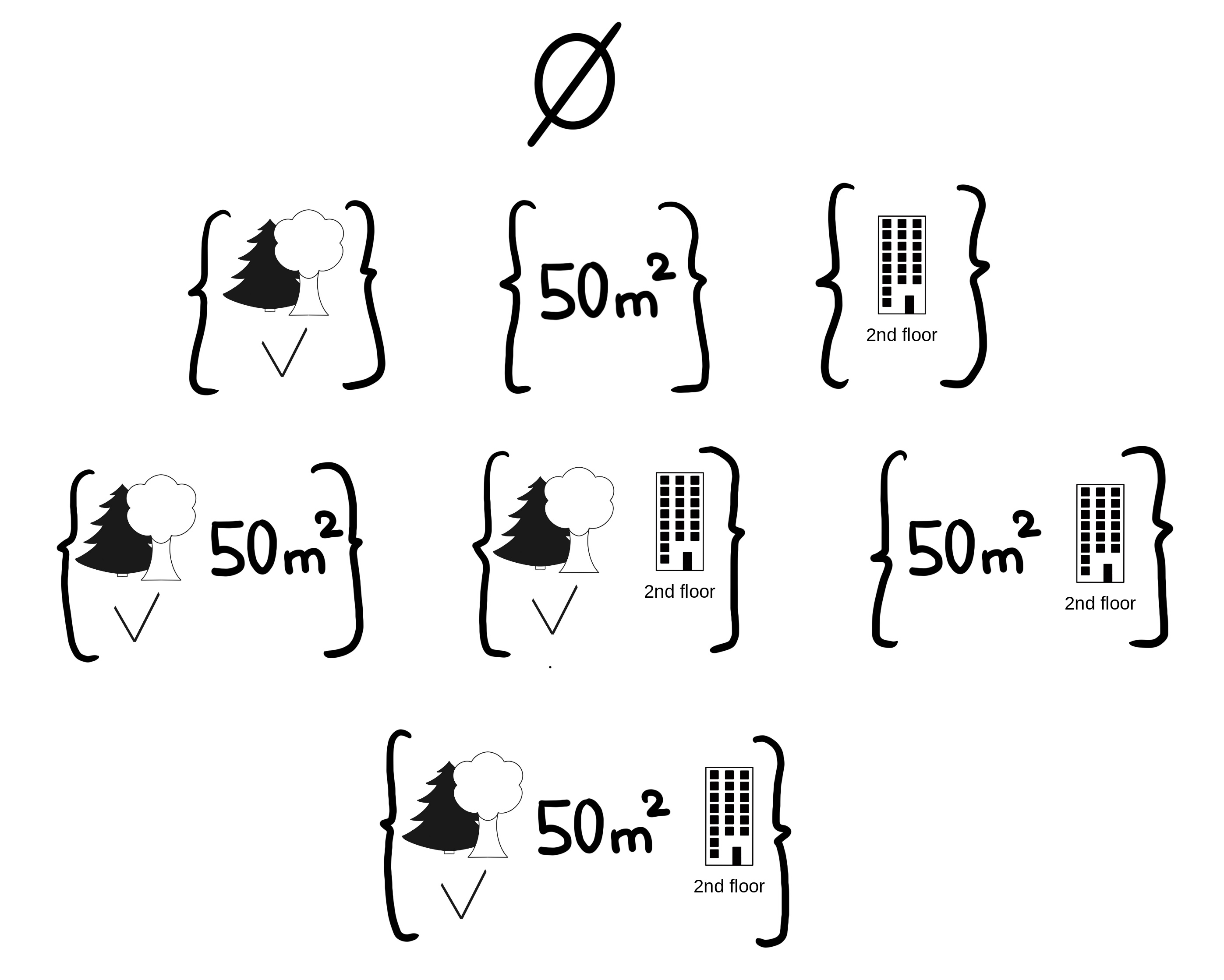

Figür 9.17: Yakındaki 2. katman bir apartman dairesi için tahmin edilen fiyat. Yakındaki park ve kedi yasağı olan 50 m²'lik 2. kat dairesi için tahmin edilen fiyat €300,000. Amacımız, bu özellik değerlerinin her birinin tahmine nasıl katkıda bulunduğunu açıklamaktır.